El Parlamento Europeo aprueba la primera Ley de Inteligencia Artificial: así se clasificará el nivel de riesgo

Se dejará de poder utilizar la IA para reconocer datos biométricos a excepción de los policías

Se establece un semáforo de cuatro colores para clasificar el nivel de riesgo de la IA

El contenido con IA no podrá ser usado como prueba en los procesos judiciales

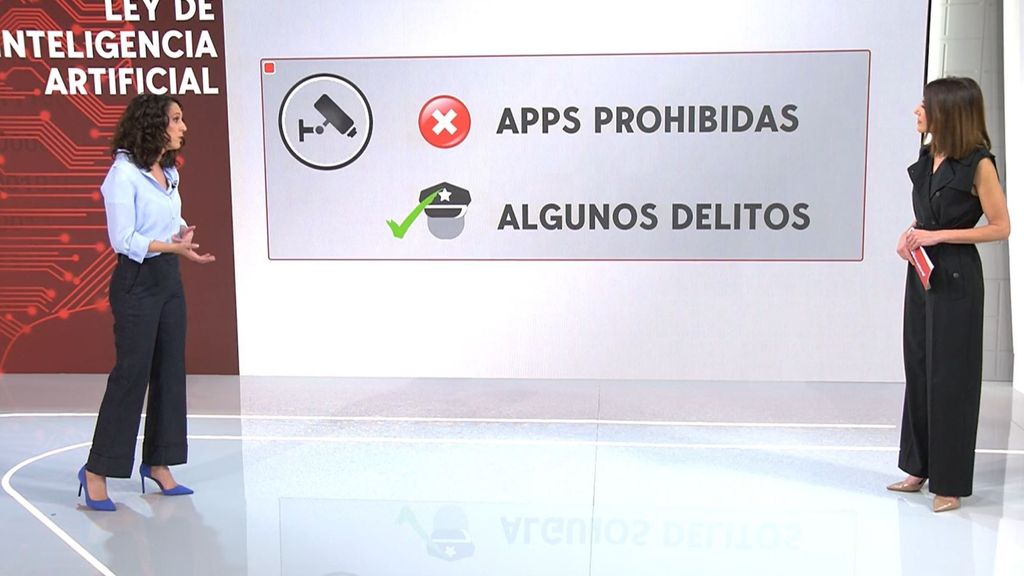

El Parlamento Europeo aprueba la primera Ley de Inteligencia Artificial con una mayoría de 523 votos, una norma que nace para frenar los peligros de esta tecnología. El objetivo es clasificar el nivel de riesgo de la IA -que generó el término de neuroderechos- para reducir las consecuencias negativas. No se podrá utilizar para reconocer datos biométricos a excepción de los policías, que sí podrán usarlo para buscar a terroristas o desaparecidos, según informa en el vídeo Dani berbel.

“Recordemos que no es más que una herramienta y una tecnología que por sí no es mala ni buena, es una más”, explica Alfonso de Castañeda, director de Zonamovilidad.es. Para quien no cumpla con las prohibiciones, se enfrentará a 35 millones de euros de multa o el 7% de la facturación. En 2026 ya estará plenamente en vigor.

Los distintos niveles de riesgo con la Ley de Inteligencia Artificial

Se aprueba una ley histórica en relación con la Inteligencia Artificial. Se establece un semáforo de cuatro colores para clasificar el nivel de riesgo de esta tecnología que puede ser muy beneficiosa para los cuerpos y fuerzas de seguridad. Pero que también puede ser dañina según el uso que se dé.

En rojo irán las aplicaciones que entrañan un riesgo extremo y que implicarán la prohibición inmediata. Un ejemplo podría ser utilizar la IA para reconocer datos biométricos como nuestro rostro. Respecto a los sistemas que generan contenidos, tendrán que respetar los derechos de autor, no plagiar y se les exigirá transparencia. Siempre que se utilice, se deberá de anunciar para no simular que sea un contenido creado por una persona.

No se podrá utilizar la IA de cara a un juicio

Las ventajas que ofrece la IA son notables, sobre todo para los cuerpos de seguridad. “Imagínate que está habiendo un atentado como el 11-M en Madrid. La Policía podría acceder a las diferentes cámaras que hay en los metros, en los trenes de cercanías de Atocha. Todo utilizando Inteligencia Artificial que podría ayudar a definir y encontrar a esa persona”, sostiene Alfonso de Castañeda. Siempre con autorización judicial.

Aunque no será una ventaja para los procesos judiciales: no podrán ser tomados como prueba. “Está muy limitado su uso de cara a un juicio”, añade Alfonso de Castañeda. Ni para que tu jefe te despida. “Sales de una reunión con tu jefe y sales enfadado, la cámara sería capaz de ver que sales enfadado por tus gestos. Todos estos temas estarían prohibidos por la Ley de Inteligencia Artificial”, sostiene el director en un tema donde los procesos electorales también están sobre la mesa, ya que se pueden dar como auténticas las imágenes hechas con esta tecnología.